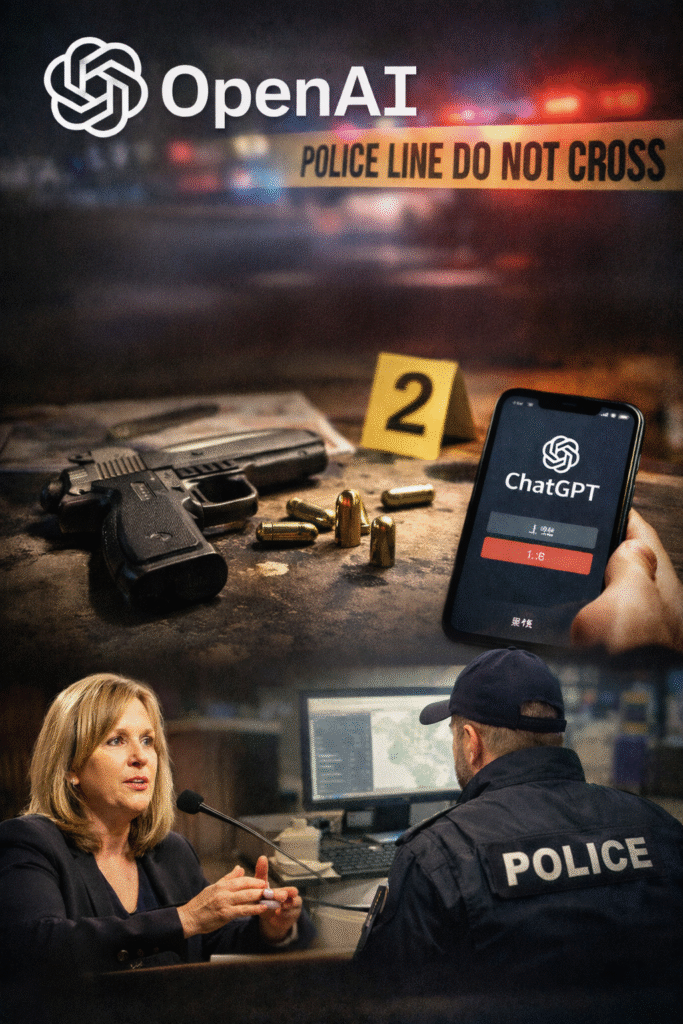

在卑诗省坦布勒岭(Tumbler Ridge)2月10日发生大规模枪击案后,人工智能公司 OpenAI 承诺将强化其安全机制,并改善与加拿大执法部门的沟通流程。此前,该公司因未就涉案人员的可疑ChatGPT账户向警方通报而受到批评。

向加政府发公开信承认不足

据Politico报道,OpenAI全球政策副总裁安·奥利里(Ann O’Leary)在致加拿大政府的公开信中承认,公司在处理与执法机构相关的报告机制方面存在不足,并公布了改进措施。

新措施包括:

- 为加拿大警方设立专门联络渠道,便于双方就潜在危险用户交换信息;

- 建立新的通报政策,当在ChatGPT对话中检测到“迫在眉睫且可信的威胁”时,即使用户未明确提及“目标、手段和具体时间”,也将向有关部门报告。

第二个账户未被及时发现

OpenAI证实,涉案人员——18岁的杰西·范·鲁特塞拉尔(Jesse Van Rootselaar)——在其第一个ChatGPT账户于去年6月因涉及枪支暴力相关提示而被封禁后,又创建了第二个账户。

公司表示,这一替代账户直到警方公布其身份后才被发现。

然而,针对首个账户,OpenAI当时选择未向警方报告。此举遭到加拿大政府的严厉批评。据报道,公司内部员工曾敦促管理层通报相关情况,但最终并未采取行动。

关于“过度执法”的争议

OpenAI此前为这一决定辩护称,该账户当时并未表现出对他人造成严重伤害的“可信风险”。公司还指出,在此类案件中过度通报,可能会给年轻用户带来不必要的压力,甚至引发隐私侵犯问题。

不过,在与政府讨论以及面临加强对聊天机器人监管的压力之后,OpenAI如今表示将采取更为严格的立场。

奥利里在信中写道:“基于我们持续获得的经验教训,在目前强化后的执法转介机制下,如果今天发现2025年6月被封禁的那个账户,我们将会向执法机构报告。”

监管压力加大

此次事件再次引发了关于人工智能平台在公共安全领域责任边界的讨论。随着各国政府对聊天机器人和生成式人工智能的监管趋严,科技公司在用户隐私保护与公共安全之间如何取得平衡,成为社会关注的焦点。

OpenAI表示,将在未来继续完善其安全与报告机制,以防范类似事件再次发生。